LGPD e a Inteligência Artificial

Categoria: Operação LAG, Segurança

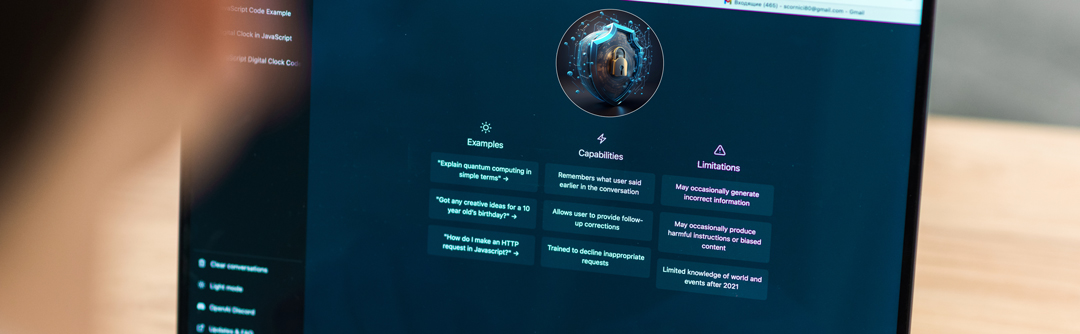

Segundo uma pesquisa da Fundação Getulio Vargas (FGV), nenhuma das sete principais plataformas de inteligência artificial (IA) — incluindo ChatGPT, Grok, Bard, Gemini, Claude, LLaMA e Ernie — atende aos requisitos fundamentais da Lei Geral de Proteção de Dados Pessoais (LGPD) do Brasil. O estudo avaliou 14 critérios essenciais da LGPD, como transparência, consentimento, finalidade, segurança e direitos dos titulares, e constatou que todas as plataformas apresentaram falhas significativas. Por exemplo, nenhuma delas oferece informações claras sobre a finalidade do uso de dados pessoais ou permite que os usuários exerçam plenamente seus direitos, como o acesso e a exclusão de seus dados.

Entre as falhas mais graves identificadas, destaca-se a ausência de consentimento explícito dos usuários para o tratamento de seus dados, o que viola um princípio central da LGPD. Além disso, as plataformas não fornecem informações adequadas sobre o compartilhamento de dados com terceiros ou sobre o tempo de retenção desses dados. Essas lacunas podem resultar em riscos significativos para a privacidade e segurança dos usuários, especialmente considerando o uso crescente de IA em diversas áreas, como saúde, finanças e educação.

A Autoridade Nacional de Proteção de Dados (ANPD) tem intensificado a fiscalização sobre o uso de IA no Brasil. Recentemente, a ANPD convocou representantes da rede social X (anteriormente conhecida como Twitter) para esclarecer o uso de dados de usuários no treinamento da IA Grok. Além disso, a ANPD instaurou processos de fiscalização contra a empresa World, criadora do ChatGPT, para investigar a coleta de dados biométricos no Brasil. Essas ações refletem a crescente preocupação das autoridades brasileiras em garantir que o uso de IA esteja em conformidade com a LGPD e respeite os direitos dos cidadãos.